弁護士法人デイライト法律事務所 代表弁護士

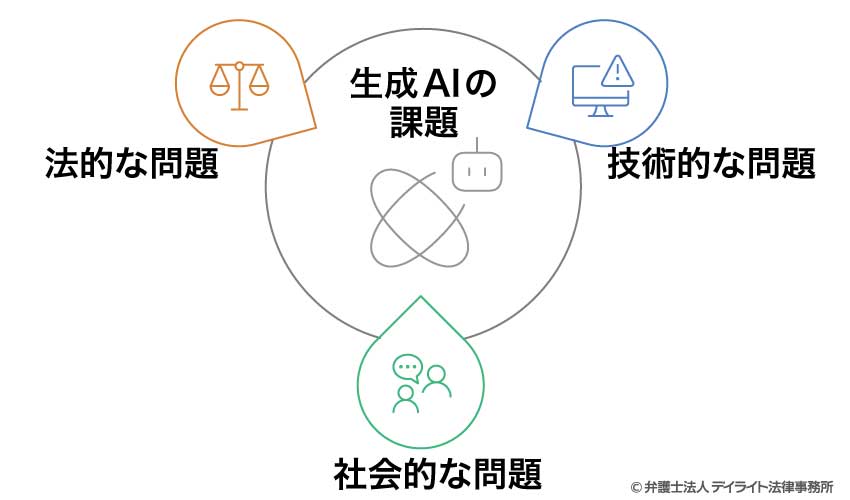

生成AIには、大きく①技術的な問題点、②社会的な問題点、そして③法律的な問題点があります。

近年、画像生成AIや文章生成AIなどの「生成AI」が急速に普及しており、多くの企業がその活用を検討しています。

生成AIは、業務効率化や創造性の向上など、さまざまなメリットをもたらす可能性があります。

しかし、新たなテクノロジーであることから、様々な問題点も抱えています。

ここでは、生成AIに注力する弁護士が問題となった事例、生成AIを規制する法律、問題点への対処法等について、わかりやすく解説しています。

生成AIの問題点に関心をお持ちの方はぜひ参考になさってください。

目次

生成AIの問題点とは?

生成AIは、文章や画像、音楽などを自動で生成する便利な技術ですが、様々な問題点も抱えています。

すなわち、①技術的な問題、②社会的な問題、そして③法律的な問題などです。

以下、詳しく見ていきましょう。

生成AIの技術的な問題点

精度と信頼性の課題

生成AIは、学習データに基づいて文章や画像を生成します。

しかし、その学習データが偏っていたり、間違った情報を含んでいたりする場合、生成されたコンテンツも不正確なものになってしまうことがあります。

このような現象はハルシネーション(hallucination:もっともらしい嘘をつくこと)と呼ばれています。

例えば、ある生成AIに「法律問題」について文章を作成させたところ、実際には存在しない法律や情報が含まれていることがあります。

また、医療に関する情報を生成させたところ、誤った診断や治療法が生成されたという事例もあります。

このように、生成AIが生成したコンテンツの中にはハルシネーションがあり、必ずしも信頼できるものではないという点が問題点として挙げられます。

ブラックボックス性

生成AIがどのようにして文章や画像を生成しているのか、そのプロセスが明確でないという点も問題です。

AIの内部処理は複雑で、人間が理解するのは困難です。

例えば、あるAIに「不倫の慰謝料はいくら?」と質問したとします。

AIは膨大なデータの中から不倫慰謝料の相場を学習し、それを元に慰謝料の金額を回答します。

しかし、具体的にどのような計算処理を経てその金額を回答したのか、不明瞭なことがあります。

このように、生成AIが「なぜ、そのような結果を出力したのか」、その理由を説明することができないことを「ブラックボックス性」と呼びます。

生成AIの社会的な問題点

雇用への影響

生成AIの普及は、私たちの社会に大きな変革をもたらすと期待される一方で、雇用への影響も懸念されています。

生成AIは、文章作成、翻訳、プログラミング、データ分析など、様々なタスクを自動化することができます。

これにより、人間の手を介さずに大量の仕事を効率的に処理することが可能になります。

例えば、カスタマーサポート業務では、AIチャットボットが顧客からの問い合わせに対応することで、人的コストを削減することができます。

また、コンテンツ制作分野では、AIが自動的に記事や動画を作成することで、制作時間を短縮することができます。

このような仕事の自動化が進むことで、一部の職種では雇用が減少する可能性があります。

特に、定型的な作業やルーティンワークが多い職種ほど、AIによる代替が進みやすいと考えられます。

例えば、データ入力や事務処理といった業務は、AIによって自動化される可能性が高いと言われています。

また、翻訳や通訳といった仕事も、AIの翻訳技術が向上することで、需要が減少する可能性があります。

一方で、生成AIの普及は、新しい仕事を生み出す可能性も秘めています。

AI技術の開発や運用に関わるエンジニアやデータサイエンティストといった職種は、今後需要が高まると予想されます。

また、AIを活用した新しいサービスやビジネスモデルが生まれることで、これまでには存在しなかった職種が登場する可能性もあります。

情報操作と悪用

生成AIは、残念ながら悪意のある目的で利用される可能性も秘めています。

その中でも特に深刻なのが、情報操作や悪用です。

生成AIは、非常にリアルなフェイクニュースや偽情報を生成することができます。

本物と見分けがつかないような偽の画像や動画、音声などを作り出すことで、人々を欺き、世論を操作することが可能になります。

例えば、政治家の発言を捏造した動画を生成し、SNSで拡散することで、選挙結果に影響を与えることも考えられます。

また、企業の評判を落とすために、偽のスキャンダル記事を生成して拡散することも可能です。

生成AIは、特定の人物の声や顔、筆跡などを模倣することができます。

これを悪用すれば、なりすましによる詐欺や誹謗中傷などが容易に行われてしまう可能性があります。

例えば、AIを使って有名人の声を合成し、偽のインタビュー動画を作成して拡散したり、本人に成り済ましてSNSで誹謗中傷を書き込んだりすることが考えられます。

生成AIは、サイバー攻撃にも利用される可能性があります。

例えば、フィッシングメールの文章を自動生成したり、マルウェアのコードを生成したりすることで、より巧妙な攻撃を仕掛けることが可能になります。

また、AIを使って標的のシステムの脆弱性を分析し、攻撃を自動化するといったことも考えられます。

生成AIの法律的な問題点

出力コンテンツ利用の著作権侵害の問題

生成AIは、既存のデータ(小説、記事、コード、画像、音楽など)を大量に学習することで、新しいコンテンツを生成します。

しかし、この出力されたコンテンツの利用において、著作権侵害のリスクが潜んでいます。

例えば、Chat GPTやDeep seekなどのAIが出力したコンテンツは、ネット上の他者の著作物であるウェブページの情報を引用している可能性があります。

その場合に当該コンテンツを複製利用すると著作権侵害の問題が生じます。

この著作権の侵害の問題については後述します。

個人データ入力と個人情報保護法違反の問題

AIは入力された情報をシステムの改善のために保存・利用したり、不正の監視のためにモニタリングしたりする場合があります。

したがって、AIへの個人情報の入力は、個人情報保護法で規制されている第三者提供に該当する可能性があります(同法27条)。

第三者提供に該当する場合、原則として本人の同意を得る必要があります。

本人の同意がない場合、個人情報保護法に違反している可能性があります。

なお、個人情報保護法の内容については後述します。

個人情報の漏洩の問題

AIは市場調査や競合分析、企業の経営分析にも活用が期待されています。

しかし、AIに従業員の情報や顧客情報等の個人情報を入力した場合に、それがAIを開発した会社から流出するリスクがあります。

この場合、委託先への監督義務違反(個人情報保護法22条)、目的外での利用禁止(同法16条)、漏洩などの事案が起きた場合の報告義務(同法22条の2)等の個人情報保護法違反の問題が生じます。

生成AIの倫理的な問題点

生成AIは、その技術的な特性から、倫理的な問題も引き起こす可能性があります。

差別や偏見の助長

生成AIは、学習データに偏りがあると、差別的なコンテンツを生成する可能性があります。

例えば、あるAIに「社長」に関する文章を作成させたところ、男性に関する内容ばかりが生成されたという事例があります。

また、AIが生成したコンテンツが、特定の属性を持つ人々に対する偏見を助長する可能性もあります。

例えば、あるAIに「犯罪者」に関する文章を作成させたところ、特定の人種に関する否定的な内容が含まれていたという事例があります。

人間の尊厳の侵害

生成AIは、人間の感情や思考を模倣することができます。

しかし、AIは人間ではありません。

AIが生成したコンテンツを、あたかも人間が作成したかのように扱うことは、人間の尊厳を侵害する可能性があります。

生成AIが問題となった事例

ここでは実際に生成AIが問題となった事例をご紹介します。

生成AIによる著作権侵害の事例

Getty Images 対 Stability AI 事件(アメリカ)

2023年、アメリカのGetty Images社が、Stable Diffusionの開発元であるStability AI社を著作権侵害で提訴しました。

Getty Images社は、Stability AI社がGetty Imagesの画像1200万枚以上を無断で学習データとして利用したと主張しました。

参考:UNITED STATES DISTRICT COURT

AI生成ウルトラマン画像の著作権侵害訴訟(中国)

2024年、中国の広州インターネット裁判所は、AIが生成するウルトラマン画像の著作権侵害について、生成AIサービス提供事業者の責任を認める判決を下しました。

裁判所は、AI生成画像がウルトラマンの画像と類似しているだけでなく、生成AIサービス提供事業者が著作権侵害を助長していると判断しました。

参考:China Intellectual Property Lawyers Network

生成AIによる個人情報漏洩の事例

サムスン電子の情報流出事件

サムスン電子の従業員が、エラー修正のために機密ソースコードをChatGPTに入力した結果、社外秘情報が流出しました。

この事例では、生成AIに入力されたデータが第三者に漏洩するリスクが顕在化し、同社はその後、社内でのChatGPTの利用を禁止しました。

参考:Forbes

生成AIを規制する法律等

上で解説したとおり、急速に普及する生成AIには様々な問題点があります。

これらの問題点が生じないように法律による適切な規制が必要です。

しかし、生成AIはこれまで人類が経験したことがない新たなテクノロジーです。

どのような規制が最適かについては現在活発な議論が行われています。

したがって、立法によって法律が整備されるまでは既存の法律を適用するしかありません。

ここでは、生成AIに関連する既存の法律のうち、重要なものをご紹介します。

著作権法による生成AIの規制

著作権法は、著作物を保護し、著作者の権利を尊重するための法律です。

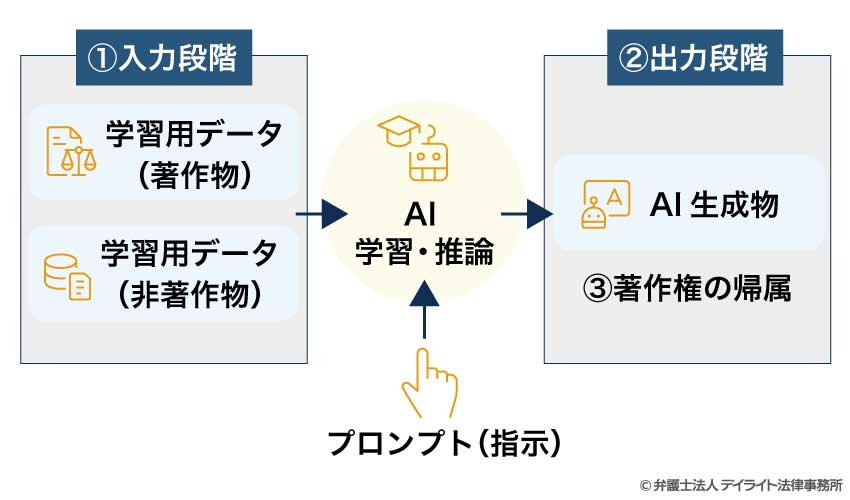

著作権法との関係では、①AIの学習のために著作物を利用できるか(入力段階の問題)、②そのAIによってコンテンツを生成・利用できるか(出力段階の問題)、という問題が生じています。

また、③生成AIが生成したコンテンツの著作権は誰に帰属するのか、という問題もあります。

以下、著作権法におけるこの3つの問題点について解説します。

①著作物をAIの学習に利用できるか

生成AIは、大量のデータを学習してコンテンツを生成します。

この学習データには、著作権で保護されたコンテンツ(文章、画像、音楽など)が含まれている場合があります。

著作権者の許諾を得ずに、これらのコンテンツをAIの学習に利用することは、著作権侵害となるのでしょうか。

学習のためにこれらのコンテンツをAIに入力することは、原則として著作権者の許諾なしで可能と考えられます。

著作権法第30条の4が「情報解析(多数の著作物その他の大量の情報から、当該情報を構成する言語、音、影像その他の要素に係る情報を抽出し、比較、分類その他の解析を行うことをいう)」については、原則として著作権者の許諾なく行うことが可能と規定しているためです(著作権法30条の4)。

ただし、利用が「情報解析」の範囲を超え、著作権者の利益を不当に害する場合には、著作権者の許諾が必要と考えられます(同条但書)。

2023年にアメリカのニューヨーク・タイムズが、Open AI(Chat GPTの開発会社)をニューヨーク・タイムズの記事をAIの学習データとして無断利用したとして提訴しました。

ニューヨーク・タイムズは訴状で、記事「数百万本」がChat GPTの学習用として許可なく使われたと主張しました。

このケースはアメリカの訴訟です。

もし、日本で同じようなケースが発生していればどうなるでしょうか。

筆者の個人的な見解ですが、ニューヨーク・タイムズが主張するように、Chat GPTを利用することで、読者が購読料を支払わずにニューヨーク・タイムズのコンテンツを読むことができ、同社が収入を失っているような事実があれば、著作権を侵害すると考えます。

②コンテンツの生成・利用の問題

文化庁は、AIに著作物であるコンテンツを「学習させる行為」と、その「生成・利用段階」では、著作物の利用行為が異なることから、両者は分けて考える必要があるとしています。

参考:A I と著作権|文化庁

例えば、次のような行為はコンテンツの生成・利用の問題となります。

- AIを利用して画像等を生成する

- 生成した画像等をネット上にアップロードして公表する

既存の著作物との「類似性」又は「依拠性」が認められない場合、これらの行為は著作権を侵害とはならず、著作権者の許諾なく行うことができると考えます。

類似性があるというためには、判例上、他人の著作物の「表現上の本質的な特徴を直接感得できること」が必要とされています。

例えば、単なる事実の記載、ありふれた表現、表現でないアイディア等は含まれません。

「依拠」とは「既存の著作物に接して、それを自己の作品の中に用いること」をいうと考えられています。

例えば、既存の著作物を認識せずに偶然に一致したに過ぎない、独自に創作した場合は依拠性はありません。

「類似性」については、AI生成物の場合もAIを利用しないケースと同様に判断されます。

類似性が認められる場合にAI生成物の「依拠性」について、どのように考えるかが問題となります。

この問題については「元の著作物がAIの学習に用いられていれば依拠性を認めてよい」「類似性があれば、依拠性ありと推定してよい」などの様々な見解があります。

筆者の個人的な見解としては、立証の問題を踏まえると、類似性が顕著であれば、依拠性を推定してよいのではないかと考えます。

現時点では裁判例がないため、今後の裁判所の判断を待つことになるでしょう。

③生成物の権利帰属

問題の最後に、生成AIが生成したコンテンツの著作権は、誰に帰属するのでしょうか。

現行の著作権法では、著作物は「思想又は感情を創作的に表現したものであって、文芸、学術、美術又は音楽の範囲に属するもの」と定義されています。

AIが生成したコンテンツは、思想や感情を伴う「創作意図」が認められないため、現在の法律では著作物として認められない可能性があります。

例えば、Chat GPTに「カレーライスのレシピを教えて下さい」と入力すると、回答を生成してくれます。

この出力結果に創作意図は認められないでしょう。

他方で、プロンプトを工夫し、生成AIを利用して創作物を生み出した場合、その人の関与度合いによっては著作権が認められる可能性があります。

ただし、この点に関する具体的な基準は現時点では明確ではないため、早急に立法によって解決すべき問題と考えます。

個人情報保護法による生成AIの規制

生成AIの利用が拡大するにつれて、個人情報の取り扱いに関する問題が浮上してきました。

個人情報保護法は、個人のプライバシーを保護し、個人情報の適切な利用を確保するための法律ですが、生成AIの利用においても、その適用が重要となります。

生成AIを利用する企業については、特に注意したいのが「個人情報の第三者提供」と「個人情報の漏洩」です。

個人情報の第三者提供について

上で解説したとおり、個人情報を第三者に提供する場合には、原則として本人の同意が必要となります(同法27条)。

(参考:個人情報保護法|eーGOV法令検索)

引用:https://laws.e-gov.go.jp/law/415AC0000000057/

例えば、会社が従業員や顧客の個人情報をChat GPT等の生成AIに入力する行為が「第三者提供」に該当しないかが問題となります。

「個人情報」とは、生存する個人に関する情報で、かつ、特定の個人を識別することができるものです。

したがって、例えば、会社が保管している従業員や顧客の氏名などの情報は個人情報です。

個人情報の具体例についてはこちらをご参照ください。

個人情報を第三者に提供する場合、原則として本人の同意が必要ですが、これには例外があります。

生成AIに関しては、クラウドサービス提供事業者が、「当該個人データを取り扱わないこととしている場合」、個人データを第三者提供したことにはならないため「本人の同意」を得る必要はないと考えられます。

また、この場合、個人データを提供したことにならないためクラウドサービス事業者を監督する義務はありません(個人情報保護法25条・27条5項1号)。

(参考:)。

参考:個人情報の保護に関する法律についての規程」に関するQ&A 7−53|個人情報保護委員会

これはクラウド例外と呼ばれています。

では、具体的にどのようなケースであれば「個人データを取り扱わないこととなっている場合」に該当するのでしょうか。

個人情報保護委員会は、当該クラウドサービス提供事業者が、「契約条項によって当該外部事業者がサーバに保存された個人データを取り扱わない旨が定められており、適切にアクセス制御を行っている場合」等と公表しています。

引用:個人情報の保護に関する法律についての規程」に関するQ&A 7−53|個人情報保護委員会

あくまで行政解釈ではありますが、この指針によれば、利用規約の条項とAI開発会社の信頼性がポイントとなりそうです。

AIに入力されたデータの利用としては、大きくAIの学習、不正監視、インシデント(事件)発生時の対応があるかと思われます。

| AIデータ利用 | 学習 | 不正監視 | インシデント対応 |

|---|---|---|---|

| タイプ1 | ○ | ○ | ○ |

| タイプ2 | × | ○ | ○ |

| タイプ3 | × | × | ○ |

| タイプ4 | × | × | × |

上記のうち、タイプ1は「個人データを取り扱わない」とはいえないでしょう。

反対に、タイプ4については、AI開発会社の従業員がいっさいアクセスしない以上、クラウド例外に該当すると考えられます。

タイプ2については、これをもってクラウド例外に該当するという見解もあります。

しかし、AI開発会社の従業員等からモニタリングされる可能性がある以上、「個人データを取り扱わない」とはいえず、現時点ではクラウド例外に該当しないと考えるほうが無難でしょう。

タイプ3については、インシデント対応のため、ユーザーの同意のもとに例外的にアクセスするのであれば、クラウド例外に該当すると解釈できると思われます。

ChatGPTは個人情報保護の設定ができます。

しかし「学習のために個人データの使用を許可しない」という設定であって、個人データをまったく取り扱わないのか不明確です。

ChatGPTにはバージョンがいくつかありますが、比較的セキュリティが強固と思われる、Enterprise版には、下記の記載があります。

「OpenAI 内では、インシデントの解決およびエンドユーザーの会話の復元(お客様からの明示的な許可を要します)を目的に(中略)、承認を受けた従業員がお客様の会話にアクセスします。」

引用:OpenAI における企業プライバシー 2024年10月31日更新の内容

※現時点の情報であり、今後ポリシーが変更される可能性があります。

AI業者への個人情報の提供が「第三者提供」に該当し、当該業者が海外の場合は、より規制が厳しいので注意が必要です。

すなわち、このような場合、原則として、あらかじめ当該業者への提供について、本人の同意を得なければなりません(個人情報保護法28条)。

そして、当該外国における個人情報の保護に関する制度や当該第三者が講ずる個人情報の保護のための措置等を当該本人に提供しなければなりません(同法)。

個人情報の漏洩について

AIに従業員の情報や顧客情報等の個人情報を入力した場合に、その情報がAI開発会社から流出するというリスクがあります。

個人情報の漏洩が発生すると、クラウド例外に該当しない場合、企業は当該AI開発会社への監督義務違反が問題となります(個人情報保護法22条)。

また、企業は個人情報保護委員会に報告し、かつ、本人に通知をしなければなりません(法22条の2)。

個人情報の漏洩が発生したのに、個人情報保護委員会への報告や本人への通知をしなかったときは違反になるので注意しましょう。

生成AIには問題点を上回るメリットも

生成AIは、上で解説したような問題点を抱えています。

しかし、それを上回るほどの大きなメリットが期待されています。

創造性の爆発

生成AIは、普段思いつかないような斬新なアイデアを生み出すことがあります。

そして、生成AIは、文章、画像、音楽など、様々な表現方法でアイデアを形にすることができます。

生産性の向上

生成AIは、文章作成、翻訳、プログラミングなどの作業を自動化することができます。

しかも、人のように眠ることがなく24時間動き続けます。

また、生成AIは、人間が長時間かけて行っていた作業を短時間で終わらせることができます。

人間の能力拡張

生成AIは、個々人が持っていない知識やスキルを提供することができます。

そして、誰もがこれらの知識やスキルにアクセスできる環境を実現することができるのです。

また、生成AIは、人間の創造性を刺激し、より豊かな発想を促すことも期待されています。

このようなAIのメリットからすると、問題があるからと言って利用しないのではなく、問題点に適切に対処していくというスタンスが重要となるでしょう。

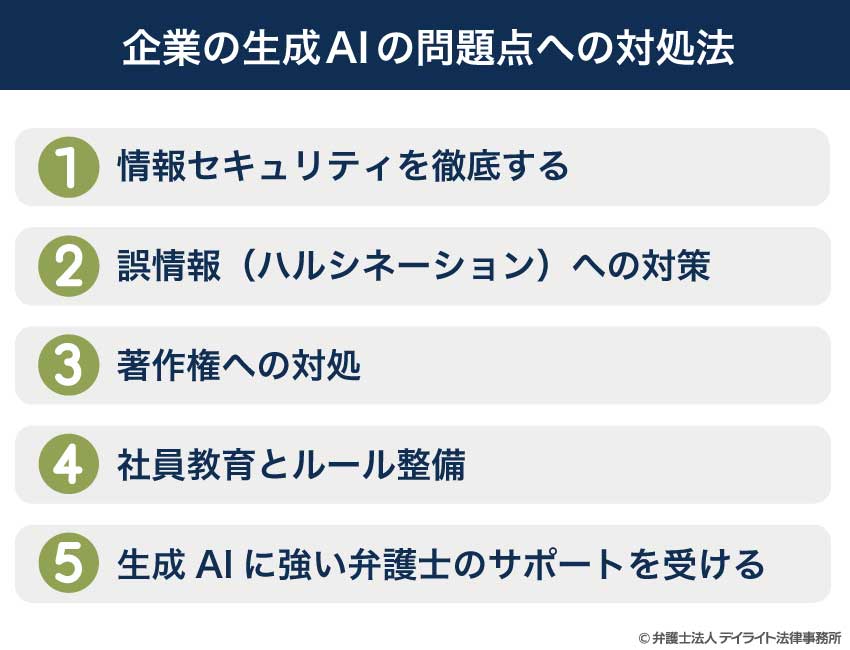

企業は生成AIの問題点にどう対処すべきか

企業の生成AIの問題点への対処法についてご紹介します。

①情報セキュリティを徹底する

現在、情報セキュリティの強化はネット環境にあるすべての企業にとって必須といっても過言ではありません。

生成AIに関しては、個人情報や社内の機密情報がAIによって外部に漏れないよう、信頼できるAIを選ぶことが重要です。

その際、開発会社の信頼性も重要ですが、利用規約を確認し、クラウド例外に該当するのか等をチェックしましょう。

②誤情報(ハルシネーション)への対策

生成AIが出力した情報についてはそのまま使用せず、人間がチェックするフローを確立しましょう。

また、法律や医療など正確性が求められる分野では、生成AIの使用範囲を補助的業務に限定すべきです。

③著作権への対処

生成AIが出力したコンテンツが著作権侵害を引き起こさないかをチェックしましょう。

引用元については、ブラックボックス性から確認できないAIが多いと思われます。

その場合、原則として出力コンテンツについては参考程度とし、複製利用(コピペ)を禁止する、などの対応を取るとよいでしょう。

④社員教育とルール整備

全社員に生成AIのメリットとリスクを理解させるための研修を実施しましょう。

また、会社として、生成AIの利用ガイドラインを策定しましょう。

生成AIは急速に発展しています。

したがって、技術の進化に合わせ、運用ルールを定期的にアップデートしていくのがポイントです。

⑤生成AIに強い弁護士のサポートを受ける

生成AIは新たなテクノロジーであり、企業にとって生産性の向上や新規事業の開拓等、ビジネスチャンスです。

他方で、上で解説したような様々な問題があります。

生成AIを活用しつつ、問題点に対処するために、生成AIに強い専門家のサポートを受けることをお勧めします。

生成AIに強い弁護士を顧問弁護士とすれば、企業の個別の状況を踏まえて、ガイドライン等の整備のほか、従業員の研修等もサポートしてくれるでしょう。

生成AIの問題点に関するQ&A

ここでは、生成AIの問題点についてのよくある質問をご紹介します。

![]()

生成AIが生成したコンテンツの信頼性はどの程度か?

すなわち、ハルシネーションや著作権侵害の可能性があるコンテンツが散見されます。

したがって、ファクトチェックや根拠の確認が必要と考えます。

![]()

生成AIで作られたイラストの著作権は誰に帰属するのか?

もっとも、プロンプトを工夫して出力したイラストについては、その人の関与度合いによっては著作権が認められる可能性があります。

まとめ

この記事では、企業が生成 AI の利用を開始する際に考慮すべき問題点と、その対処法について解説しました。

生成 AI は、不正確な情報、著作権侵害、偏見、プライバシー侵害などの潜在的な問題を引き起こす可能性があります。

企業は、これらの問題点を認識し、社内規定の作成、適切なツールの利用、監視と評価、倫理的配慮など、さまざまな対策を講じる必要があります。

これらの対策を講じることで、企業は生成 AI の可能性を最大限に活用し、同時にリスクを最小限に抑えることができます。

当事務所には生成AIの活用を法的にサポートするチームがあり、企業の生成AI活用を推進しています。

生成AIについては、当事務所の企業法務チームまでお気軽にご相談ください。